Silicio

Enciclopedia della Scienza e della Tecnica (2007)

Silicio

Come scrive Frederick Seitz nel suo libro sulla storia del silicio, la moderna autostrada informatica e computazionale che ha modificato il nostro modo di comunicare e di produrre, sì da generare una nuova rivoluzione tecnologica, è pavimentata con minuscoli chips di silicio cristallino. Tali elementi costitutivi sono oggi prodotti in fabbriche estremamente sofisticate, dotate delle più avanzate attrezzature chimiche e ingegneristiche del costo di oltre due miliardi di dollari ognuna, che consentono di ottenere prodotti sempre più efficienti, con costi sempre decrescenti per unità di informazione e con numero sempre crescente di informazioni comunicabili.

Questo è stato reso possibile dalla comprensione dei fenomeni dovuti al comportamento degli elettroni sulla base dei concetti della meccanica quantistica, in una particolare classe di materiali chiamati semiconduttori per le proprietà intermedie tra quelle dei metalli e quelle degli isolanti. Tra essi il silicio occupa un posto speciale, ed è importante capirne le ragioni per rendersi conto del suo ruolo nella moderna microelettronica e delle speranze in esso riposte per la futura nanoelettronica e per la fotonica.

La scoperta del silicio è dovuta ad Antoine-Laurent Lavoisier, considerato l'iniziatore della chimica moderna per aver intuito che tutte le sostanze sono combinazioni diverse di pochi elementi. Egli suggerì nel 1789 che la sabbia (silex nel latino classico) era fondamentalmente un composto dell'ossigeno ‒ isolato pochi anni prima da Joseph Priestley ‒ con un importante elemento non ancora noto. L'uccisione mediante ghigliottina da parte dei rivoluzionari giacobini non gli permise di isolarlo e toccò ai suoi discepoli Louis Gay-Lussac e Louis Thénard ottenere per primi tale elemento nel 1811, facendo reagire il fluoruro di silicio con potassio riscaldato. Nel 1824 il chimico svedese Jacob Berzelius lo ottenne in quantità maggiori, per riduzione con potassio metallico, dal fluosilicato di potassio.

Si riconobbe subito che il silicio è uno dei più abbondanti elementi della crosta terrestre, in quanto è presente, oltre che nella sabbia, in una enorme varietà di sali che si trovano nel terreno e nelle rocce. Si sviluppò rapidamente il dibattito sulla sua natura, ossia se fosse un metallo, come pensava Berzelius sulla base del suo aspetto fisico, o un isolante, come invece riteneva Humphrey Davy, che aveva eseguito nella prima metà dell'Ottocento estese misure di conducibilità su una grande varietà di materiali.

Doveva passare più di un secolo prima che tale dilemma fosse risolto, e solo al tempo della Seconda guerra mondiale le conoscenze dei solidi cristallini di silicio e la loro produzione allo stato puro resero possibile stabilirne con certezza la natura semiconduttrice.

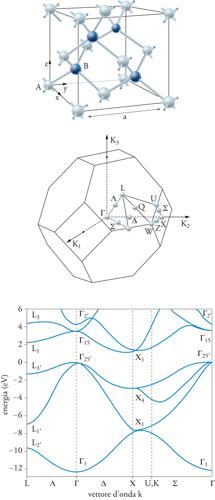

Già nella seconda metà dell'Ottocento il silicio era stato ottenuto in forma cristallina da Friedrich Wöhler, e più tardi divenne noto che la sua struttura è uguale a quella del diamante: due reticoli a facce centrate, spostati di a(1/4, 1/4, 1/4) lungo la diagonale, in modo che ogni atomo sia al centro di un tetraedro regolare.

La prima applicazione importante del silicio si sviluppò alla fine dell'Ottocento nel campo della siderurgia. L'aggiunta di silicio nel processo di fusione del minerale ferroso negli altiforni conduceva a una migliore qualità dell'acciaio, perché combinandosi con il carbonio e con l'ossigeno evitava che si formassero vuoti d'aria dovuti a bolle di ossido di carbonio o anidride carbonica. Più tardi si scoprì che un'opportuna miscela di silicio nel laminato di ferro produceva un orientamento privilegiato dei grani cristallini in modo da ottenere lamine magnetiche dalle caratteristiche ottimali per i trasformatori e i motori elettrici, minimizzando le perdite di energia per isteresi. Tali lamine magnetiche al silicio sono ancora oggi uno dei più importanti prodotti della siderurgia. Le acciaierie di Terni ne producono duecentomila tonnellate all'anno.

L'importanza del silicio nella metallurgia favorì lo sviluppo di metodi efficaci ed economici per la sua produzione, quali per esempio quello di riscaldare miscele di sabbia, carbone e ferro o alternativamente di ridurre la silice in presenza di magnesio e zinco. La società Carborundum sviluppò un metodo che partiva dalla silice (quarzo: SiO2) in forma di polvere sabbiosa e ne otteneva la riduzione con il coke usato negli altiforni per la produzione del ferro.

Introduzione e cenni storici

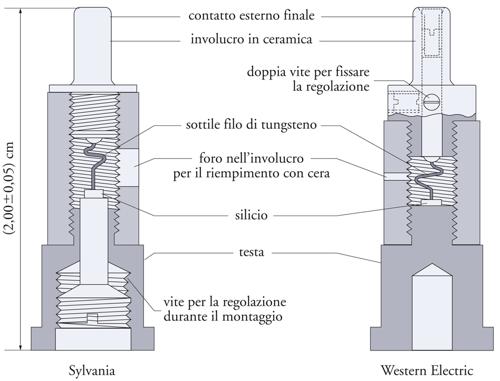

Nel 1939, alla vigilia della Seconda guerra mondiale, i due giovani fisici inglesi Denis M. Robinson e H.W.B. Skinner scoprirono che il silicio, se messo a contatto con il tungsteno, era il miglior rivelatore a cristallo per onde centimetriche prodotte dai magnetron o dai klystron e usate per il radar.

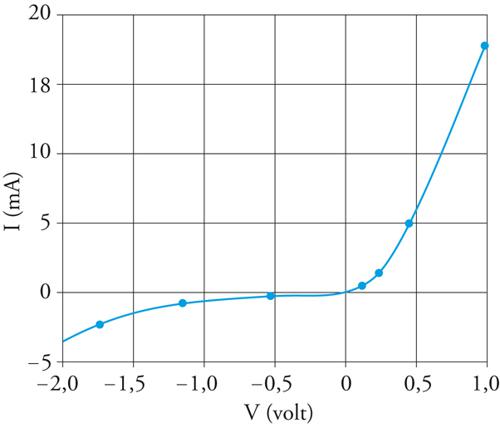

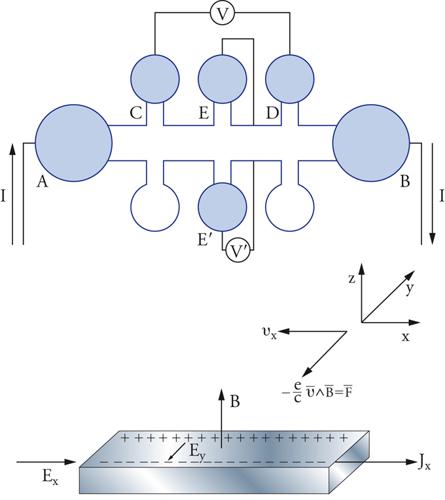

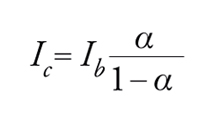

Raddrizzatori a cristallo erano già usati dall'inizio del secolo quali rivelatori di onde radio perché il trasportare la corrente in una direzione e non in direzione opposta consentiva di attivare dispositivi acustici, che non avrebbero segnalato correnti alternate di frequenza elevata (tipici erano i rivelatori a galena, PbS, già in uso nel Titanic e utilizzati comunemente fino agli anni Trenta). Dopo la Prima guerra mondiale le valvole termoioniche, con la loro maggiore affidabilità e la possibilità di amplificare la corrente inserendo una griglia (triodo), avevano però sostituito gradualmente i cristalli nella tecnologia radiofonica e avevano segnato l'inizio dell'elettronica. Fu il ritorno ai diodi a cristallo nel caso delle microonde a rimettere in gioco il silicio e a stimolarne lo studio sistematico. Una tipica immagine della risposta del contatto silicio-tungsteno è riportata nella fig. 1 e un esempio di rivelatore radar viene presentato in fig. 2. Il problema della scarsa affidabilità dei dispositivi e la difficile riproducibilità delle proprietà continuò tuttavia a esistere, tanto che Wolfang Pauli chiamò fisica sporca quella dei fenomeni elettrici nei solidi, ma solo fino a quando negli Stati Uniti vennero prodotti monocristalli con elevato grado di purezza nel periodo della Seconda guerra mondiale. Dopo di allora fu possibile studiare il comportamento elettrico e ottico dei solidi ed ebbe impulso la fisica dei semiconduttori, che anzitutto permise di capire la ragione per cui il contatto metallo-semiconduttore raddrizza la corrente e consentì a John Bardeen, Walter Brattain e William Shockley di ottenere il fenomeno dell'amplificazione con il transistor nel 1948.

Lo studio della struttura elettronica dei solidi aveva già avuto un'evoluzione negli anni Trenta in seguito all'affermarsi dei concetti della meccanica quantistica, delle statistiche quantistiche e del concetto di fotone per gli scambi di energia tra radiazione e materia. Alan H. Wilson sviluppò per primo i concetti delle bande di energia nei metalli e nei semiconduttori, e Eugen P. Wigner e Frederick Seitz fornirono il primo metodo per il loro calcolo a partire dall'equazione di Schrödinger nei cristalli. Dopo la Seconda guerra mondiale si capì che i semiconduttori sono una categoria di isolanti caratterizzata da una piccola separazione (gap) tra le energie della banda di valenza occupate dagli elettroni e quelle delle bande di conduzione vuote, ed essi furono oggetto di studi approfonditi, particolarmente negli Stati Uniti, nei laboratori della Bell Telephone e in molte università. Il vantaggio che queste sostanze offrono è di poter avere un'elevata conducibilità elettronica, popolando la banda di conduzione o creando 'buche' nelle bande di valenza, e di poterla controllare con impurezze e giunzioni opportune. Lo studio approfondito sia teorico che sperimentale dei semiconduttori ha impegnato tutta la seconda metà del secolo scorso ed è ben lungi dall'essere concluso. I risultati hanno aperto nuove strade alla scienza e alla tecnologia.

Il silicio e il germanio vennero riconosciuti come tipici semiconduttori, con gap di energia a temperatura ambiente rispettivamente di 1,2 eV e 0,67 eV e dotati di elevate mobilità elettroniche. Inizialmente gli studi si concentrarono sul germanio per la sua maggiore mobilità elettronica e infatti di germanio furono i primi transistor e i diodi a cristallo utilizzati nei circuiti elettronici. Dopo il 1960, quando Jack S. Kilby e Robert N. Noyce svilupparono i primi circuiti integrati, scavando canaletti sulla superficie del silicio ed evaporando in essi un sottile strato metallico in modo da eliminare la necessità di fili e di contatti per tutti i passaggi di corrente, il silicio divenne l'elemento base di tutta la microelettronica. Il grande suo vantaggio è che l'ossido di silicio, che si forma alla superficie e separa gli elementi dei circuiti, è un ottimo isolante e non è igroscopico. Il silicio inoltre è abbondante e può essere preparato in grandi lingotti macrocristallini con contenuto di impurezze controllabile.

Negli ultimi decenni del secolo scorso, ai semplici circuiti con resistenze e transistor si aggiunsero induttanze e memorie in numero sempre crescente per unità di superficie e si ottennero i cosiddetti microprocessori, nei quali un intero sistema di calcolo è impiantato alla superficie di un chip di silicio di pochi centimetri quadrati. Oggi un foglio di silicio monocristallino, o wafer, tipicamente del diametro di 30 cm (12 pollici) e dello spessore di 950 μm, contiene un numero elevato di chip elementari e può essere l'equivalente di un enorme calcolatore elettronico che originariamente occupava intere stanze: il passaggio dalla microelettronica alla nanoelettronica (con elementi di circuito di dimensioni atomiche) è sempre più in atto.

Mentre è indubitabile che i principali usi del silicio sono nell'elettronica e nelle telecomunicazioni, altre applicazioni in atto e potenziali sono quelle relative all'optoelettronica, con conversione di luce in energia (celle solari), produzione di radiazione laser, trasmissione di segnali con fibre ottiche.

Concetti di base e struttura elettronica

I principî di base che consentono la comprensione dei fenomeni elettronici nei semiconduttori, e nel silicio in particolare, sono quelli della meccanica quantistica applicata ai cristalli.

Le energie degli stati elettronici sono gli autostati dell'equazione di Schrödinger del sistema a molti elettroni, con i nuclei nelle posizioni reticolari. La simmetria cristallina introduce un buon numero quantico, il vettore k nello spazio del reticolo reciproco, definito nella zona di Brillouin (Z.B.). Questa è ottenuta come il minimo spazio racchiuso dai piani che bisecano i vettori del reticolo reciproco. Il numero di vettori k è uguale al numero di celle elementari del cristallo e perciò le energie possibili per gli elettroni sono suddivise in bande quasi continue En(k). Esse sono occupate dagli elettroni secondo il principio di esclusione di Pauli e a temperatura definita secondo la distribuzione statistica di Fermi-Dirac. Questo spiega qualitativamente la differenza tra isolanti e metalli. In questi ultimi infatti il livello di Fermi EF che separa gli stati occupati da quelli vuoti si trova all'interno di una banda di energie permesse nella quale gli elettroni si possono muovere. Negli isolanti EF si trova invece nel gap di energia proibita e gli stati delle bande, a temperatura zero, sono tutti occupati o tutti vuoti e questo non permette trasporto di cariche elettriche. La conoscenza della struttura a bande e del numero di elettroni per cella elementare consente quindi di conoscere le proprietà di trasporto di elettroni in ogni sostanza allo stato cristallino.

Nel caso dei semiconduttori il gap Eg è sufficientemente piccolo da consentire a una parte degli elettroni, per effetto della distribuzione statistica, di occupare la banda di conduzione normalmente vuota e quindi di condurre corrente elettrica a temperatura abbastanza elevata. Inoltre la presenza di impurezze sostitutive con un numero di elettroni di valenza maggiori (o minori) dell'atomo che sostituiscono introduce elettroni aggiuntivi (o buche), che possono essere legati all'impurezza con energia di legame molto minore di Eg perché la costante dielettrica è grande (dell'ordine di 10) e scherma il potenziale coulombiano. Per effetto della distribuzione statistica gli elettroni (o buche) introdotti dalle impurezze possono occupare le bande di conduzione (o di valenza) e condurre la corrente.

I metodi di risoluzione dell'equazione di Schrödinger sono molto complessi e vennero affrontati dopo che i concetti di base sopra ricordati erano già acquisiti. Essi richiedono approssimazioni di vario tipo, delle quali la più immediata è la costruzione di un potenziale medio nel quale si muovono tutti gli elettroni di valenza. Tale potenziale deve comprendere l'attrazione coulombiana dei nuclei verso gli elettroni e la repulsione fra gli elettroni stessi. Quest'ultima è esprimibile, come media, dalla densità elettronica e deve inoltre contenere un termine di scambio, dovuto all'antisimmetria della funzione d'onda per scambio di elettroni, che spesso è approssimato con un'espressione che lo lega alla densità elettronica locale ϱ; una stima delle correlazioni si può inoltre rappresentare con uno schermo opportuno del precedente termine di scambio. In generale è possibile esprimere con buona approssimazione il potenziale medio del cristallo come somma di potenziali atomici (o localizzati sugli atomi e coincidenti con i potenziali atomici vicino ai nuclei).

Il primo calcolo della struttura a bande del silicio, che ne giustifica correttamente le proprietà elettroniche, è stato ottenuto con il metodo dello sviluppo in onde piane ortogonalizzate agli stati interni e da allora il silicio è stato un banco di prova per tutti i calcoli di struttura a bande con metodi sempre più raffinati. La struttura dei livelli elettronici del silicio è rappresentata nella fig. 3, accanto alla struttura cristallina e alla zona di Brillouin. Si può notare che il massimo della banda di valenza è a k=0 in corrispondenza dello stato 3Γ25′ di degenerazione tre (così classificato per la sua proprietà di simmetria); se si tiene conto dell'interazione spin-orbita esso è poi separato in due stati di degenerazione 4 e 2 4Γ8 e 3Γ7 (distanti 0,044 eV). Il minimo della banda di conduzione è lo stato 2Δ1 (a k=(0,83, 0, 0)2π/a) separato dal massimo della banda di valenza di Eg=1,2 eV a temperatura ambiente. La simmetria impone una massa efficace anisotropa (ml*=0,98m, ml*=0,19 m) per gli elettroni nella banda di conduzione e masse isotrope (mh*=0,5m e mh*=0,16m) per le buche nella banda di valenza. Tale struttura a bande è stata verificata con vari tipi di esperimenti, i più importanti dei quali sono lo studio delle proprietà ottiche (dispersione e assorbimento) che vengono calcolate dalla struttura a bande. I valori delle masse effettive nel silicio sono stati ottenuti già nel 1953 con esperimenti di risonanza di ciclotrone, separando i livelli con un campo magnetico e inducendo transizioni tra essi con assorbimento di microonde.

La scelta del tipo di impurezze e della loro concentrazione consente di calcolare la posizione del livello di Fermi EF nel gap di energia proibita. Nel caso di impurezze donatrici (per es., N o P in Si) EF è prossimo alla banda di conduzione e la conducibilità è dovuta prevalentemente agli elettroni, mentre in quello di impurezze accettrici (per es., B o Gd in Si) EF è prossimo alla banda di valenza e la conducibilità è dovuta alle buche. Nel caso intrinseco (Si totalmente puro o ad alte temperature), EF è al centro del gap di energia proibita e il numero di elettroni presenti è uguale al numero delle buche. La conoscenza del numero n di elettroni e buche per unità di volume consente di calcolare la densità di corrente J dalla relazione J=σE, con la conducibilità data da

[1] σ=neμee+nhμhe

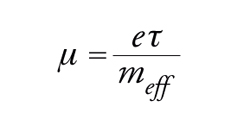

dove la mobilità (o velocità dell'unità di carica per unità di campo elettrico) è legata alle masse efficaci e al tempo medio di collisione τ:

[2] formula.

In generale la densità dei portatori può essere controllata attraverso il contenuto di impurezze prevalenti ed è comune distinguere due casi: semiconduttori di tipo n (portatori negativi) per conducibilità dovuta agli elettroni, semiconduttori di tipo p (portatori positivi) per conducibilità dovuta alle buche.

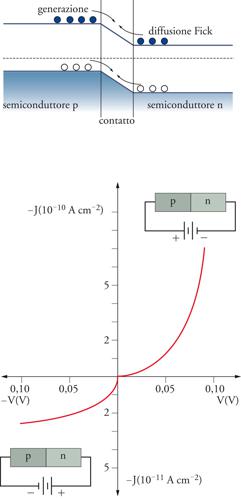

La conducibilità elettrica è sostanzialmente controllabile dal numero dei portatori n, perché per ogni semiconduttore μ è fissata a ogni temperatura e il suo valore nel silicio è ragionevolmente elevato anche se inferiore a quello del germanio. Il numero di portatori e la loro carica elettrica possono essere misurati mediante l'effetto Hall, scoperto nel 1879, che consiste nel generare un campo elettrico tra due facce di un cristallo percorso da corrente applicando un campo magnetico costante a essa perpendicolare. Lo schema è indicato in fig. 4. Il campo elettrico è perpendicolare alla corrente e al campo magnetico e, dovendo compensare la forza di Lorentz νxBze/c, ha il valore

[3] Eg=RHJxBz

dove la costante di Hall è data da

[4] formula.

A titolo di esempio si considerano la conducibilità e la costante di Hall di un campione di silicio in funzione della temperatura. Si può osservare che ad alta temperatura prevale la conducibilità intrinseca (dipendente da Eg), mentre a bassa temperatura la conducibilità è legata alle impurezze (dipende dalla loro concentrazione ed energia di legame Ed). La dipendenza dalla temperatura ha comunque un andamento esponenziale come indica la distribuzione statistica.

Diodi, giunzioni, transistori

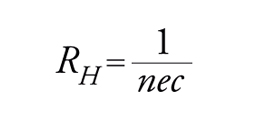

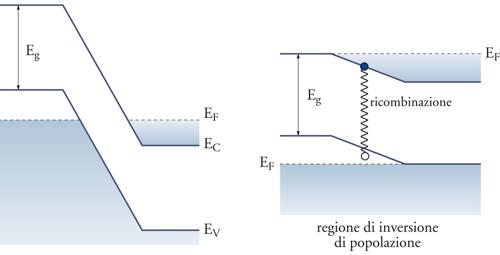

I primi dispositivi realizzati con il contatto metallo-silicio sono i diodi raddrizzatori, come detto nell'introduzione. La spiegazione del loro effetto di raddrizzare la corrente è dovuta alla presenza di una barriera di potenziale χ alla superficie di contatto, generata dalla presenza di impurezze nel semiconduttore, i cui elettroni (o buche) tendono a trasferirsi nel metallo, in modo da uguagliare il suo potenziale chimico, che deve coincidere con il livello di Fermi, a quello del semiconduttore. Lo schema è presentato nella fig. 5 per il caso di silicio di tipo n, nel quale il livello di Fermi è vicino alla banda di conduzione.

In assenza di potenziale applicato la corrente degli elettroni che fluiscono in una direzione è compensata da quella in direzione opposta. Gli elettroni che dal metallo possono passare al semiconduttore sono solo quelli che superano la barriera, a partire dal livello di Fermi, mentre dal semiconduttore al metallo sono quelli che le impurezze introducono nella banda di conduzione. L'abbassare la barriera e quindi la banda di conduzione del silicio alla superficie, a causa dell'aumento esponenziale dei primi, dovuto alla distribuzione statistica che li vede proporzionali a exp(−(χ±V)e/kT), accresce il numero di elettroni che si spostano dal metallo al semiconduttore, mentre non modifica il numero di elettroni che fanno il percorso inverso. Questo produce passaggio di corrente con il potenziale applicato. Con potenziale inverso non cambia apprezzabilmente il numero di elettroni che fluisce dal metallo né quello che fluisce dal semiconduttore; è come aumentare l'altezza di una cascata, il flusso totale non viene alterato. L'esempio storico di corrente in funzione del potenziale in una giunzione silicio-tungsteno è stato riportato in fig. 1 e viene così interpretato.

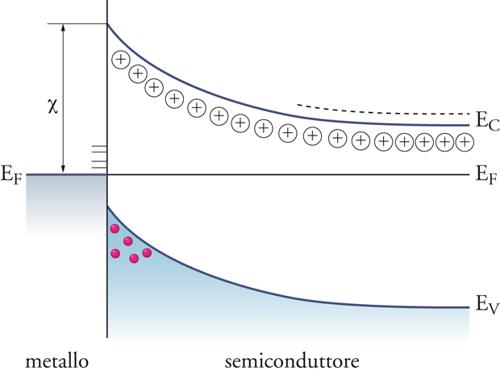

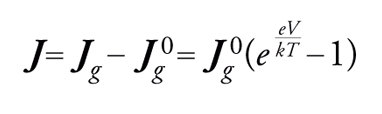

Con un ragionamento simile si può capire che anche una giunzione di due semiconduttori di tipo diverso raddrizza la corrente, e agisce come un diodo termoionico. L'esempio di una giunzione p-n è mostrato in fig. 6. La necessità di uguagliare la posizione del livello di Fermi (che coincide con il potenziale chimico) nei due cristalli produce una barriera di potenziale per gli elettroni dal cristallo n al p e una barriera di segno opposto per le buche. La corrente di elettroni in direzione n-p è portata solo da quelli che hanno energia superiore alla barriera (corrente di ricombinazione) e viene modificata da una sua variazione; quella in direzione p-n (di generazione) non viene modificata apprezzabilmente da un potenziale esterno V. Pertanto, essendo all'equilibrio, Jg0= Jp0, con un potenziale esterno abbiamo

[5] formula

da cui è evidente l'effetto raddrizzante quando eV è positivo e abbassa la barriera.

Realizzato il diodo con una giunzione n-p (o p-n), è immediato realizzare il transistor con una doppia giunzione n-p-n (o p-n-p). Anche se il primo transistor venne realizzato nel 1948 con due contatti metallici, subito dopo venne ottenuto quello a doppia giunzione, utilizzato sopratutto nel silicio. Da esso ebbero origine gli sviluppi più importanti successivi.

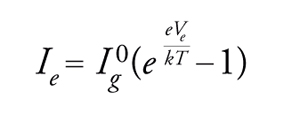

Il transistor è caratterizzato da due giunzioni a potenziale diverso e da tre contatti. Il primo è il contatto n-p con potenziale Ve (emettitore); il secondo è il contatto della seconda giunzione p-n con potenziale Vc (collettore); il terzo è il contatto a potenziale VB (base) del semiconduttore intermedio. La base funziona come la griglia del triodo delle valvole ioniche, e si producono due correnti, una nel circuito emettitore-base e l'altra nel circuito emettitore-collettore, con la resistenza R esternamente introdotta. Ricordando che per le proprietà del diodo n-p la corrente è

[6] formula

e che solo una piccola parte, Ib, viene dirottata nel circuito di base (che si può porre a terra) mentre quasi tutta la rimanente si scarica nella giunzione p-n, si ha per la corrente al collettore

[7] Ic=Ie−Ib

e ponendo Ie=Ic/α, si ottiene

[8] formula

che, per α vicino a 1, produce una grande amplificazione della corrente del circuito di base. Si ottennero subito amplificazioni di due ordini di grandezza (>100). Si noti che il transistor agisce anche come elemento di logica, caratterizzato da due stati, spento e acceso. Nel primo caso Ib=0, quindi Ic≃0 e V≠0. Nel secondo caso si ha Ib≠0, e quindi anche Ic è presente, e la tensione è quasi nulla. Si hanno quindi due stati in uscita, alta e bassa tensione, che possono essere associati a due stati logici 1 e 0, o viceversa.

Una variante molto utile di transistor è stata ottenuta applicando un potenziale opportuno alla base, in modo da generare un campo elettrico che attira gli elettroni e ne favorisce il trasporto da una giunzione all'altra. In questo caso si può ottenere un dispositivo nel quale il circuito è tutto alla superficie del silicio, e il potenziale di base alla porta è responsabile dell'amplificazione di corrente. Tale tipo di transistor (MOSFET, Metal oxide semiconductor field effect transistor) ha il vantaggio che i contatti sono ottenuti scavando canaletti nell'ossido che ricopre la superficie, e diffondendo metallo in essi. Il grande vantaggio del silicio è che il suo ossido è perfettamente isolante e non è igroscopico, e quindi il microcircuito ottenuto alla sua superficie è permanente e non si altera. Il silicio inoltre è un materiale comodo e abbondante. I transistor MOSFET al silicio vennero ampiamente usati a partire dagli anni Cinquanta. Essi sono transistor planari, nei quali tutto avviene in un sottile strato superficiale, che può essere ottenuto su fogli (wafer) dello spessore di pochi micron, tagliati da lingotti monocristallini di dimensioni e purezza desiderate. Uno schema che indica lo sviluppo dei diversi tipi di transistor è mostrato nella Tav. I.

Il metodo di produzione dei monocristalli maggiormente utilizzato è dovuto a Jan Czochralski e consente di ottenere, sotto opportune condizioni tecniche, un lungo cilindro cristallino del diametro voluto. Il diametro in uso nell'ultimo decennio è di 8″ (∼20 cm), ma ormai sono comuni i lingotti del diametro di 12″ (∼30 cm).

Circuiti integrati, microprocessori e calcolatori

La miniaturizzazione dei transistor e dei circuiti è stata resa possibile dalla deposizione di materiale scelto nei punti voluti della superficie del silicio. Questo condusse alla fine degli anni Cinquanta Jack S. Kilby e Noyce all'invenzione dei circuiti integrati. Essi consistono in un sistema elettronico completo, senza connessione di fili, ottenuto incidendo sulla superficie del silicio, come abbiamo indicato per i transistor planari, speciali canaletti contenenti resistenze, capacità, induttanze e interconnessioni, isolati dall'ossido di silicio. Tutti i componenti del circuito erano fabbricati mediante deposizione o impiantazione con bombardamento ionico di sostanze opportune nelle posizioni scelte.

La scoperta fu realizzata nel 1959 alla Texas Instruments e alla Fairchild Semiconductors, e da allora il progresso è stato continuo e velocissimo. La miniaturizzazione è stata continuamente migliorata utilizzando la tecnica dei polimeri fotoresistivi, cioè materiali organici speciali che polimerizzano a forma insolubile quando esposti alla luce o al bombardamento con elettroni. Le zone non esposte, determinate sovrapponendo alla superficie una speciale maschera di zone vuote e zone protette, vengono private della protezione mediante un bagno chimico polimerico e in esse si possono introdurre impurezze opportune in modo selettivo, scavare canali e riempirli di strati metallici, semiconduttori o ossidi isolanti a scelta.

Estendendo questo metodo e utilizzando maschere sempre più precise, si ottengono i microcircuiti descritti, i quali, in conseguenza della estrema miniaturizzazione, limitata soltanto dalla possibilità di localizzazione laterale della luce o degli elettroni, consentono di ottenere un enorme aumento di posizioni di memoria utilizzando vari tipi di combinazioni di transistor e di capacità. Un esempio di memoria è il transistor planare a effetto campo con una base (o porta) isolata dalla superficie mediante un sottile strato polimerico capacitivo nel quale gli elettroni possono essere catturati per effetto tunnel in presenza di un campo elettrico, schermando così il campo applicato e diminuendo l'amplificazione. Il non funzionamento o il funzionamento del transistor dice se è stato applicato il campo elettrico o no, e quindi agisce come memoria. Aumentare il numero di tali transistor a porta fluttuante consente quindi di aumentare corrispondentemente le posizioni di memoria.

Dopo lo sviluppo dei circuiti integrati, alcuni degli scopritori capirono che una tecnologia tanto promettente difficilmente si sarebbe sviluppata appieno in una società industriale esistente e con tanti altri problemi. Per questo Robert Noyce e Gordon Moore fondarono all'inizio degli anni Settanta la società Intel, interamente dedicata all'elettronica al silicio, e molti altri ricercatori diedero vita a società analoghe, costituendo una rete industriale in quella zona della California, che venne chiamata Silicon Valley proprio perché sede della tecnologia del silicio. In Italia alla fine degli anni Cinquanta venne fondata dall'ingegner Virginio Floriani a Milano la S.G.S. (Società Generale Semiconduttori), che due decenni dopo, in collaborazione con la Thomson francese, divenne la S.T. Microelectronics (Semiconductor technology and microelectronics), con laboratori a Milano e Catania e due stabilimenti a Catania. Essa è oggi la terza industria mondiale nel settore, dopo la Intel e la Toshiba giapponese.

Una conseguenza pressoché fatale dello sviluppo industriale della tecnologia al silicio fu la possibilità di incorporare in un singolo chip un intero calcolatore elettronico ottenendo così il microprocessore. Il primo tentativo fu dell'ingegnere giapponese Mashatoshi Shima, che progettò un intero calcolatore con pochi chip di silicio, ma fu merito di Federico Faggin, che dalla S.G.S. si era trasferito alla Fairchild e poi alla Intel, realizzare nel 1971 il primo microprocessore a singolo chip. Esso conteneva porte di entrata e uscita di corrente, un'unità aritmetico-logica per operazioni di ogni tipo, e memorie, cioè tutti gli elementi di un calcolatore elettronico. Da allora lo sviluppo è stato continuo e impressionante, caratterizzato da un aumento esponenziale del numero di transistor per chip, dal migliaio del 1971 al miliardo del 2002, secondo la legge di Moore per cui il numero di transistor per chip raddoppia ogni quattro anni. Contemporaneamente il costo per bit di memoria decresce esponenzialmente, da un centesimo di dollaro nel 1970 a meno di un millicentesimo negli anni Novanta. Tutto questo ha reso possibile lo sviluppo tecnologico che stiamo vivendo, anche se il costo di ogni fabbrica è progressivamente aumentato per la sempre maggiore complessità della produzione.

I microprocessori costituiscono poi la base di partenza per giganteschi calcolatori dalle possibilità pressoché illimitate. Usati in parallelo in modo opportuno, anche un grande numero di comuni PC a singolo microprocessore consente di ottenere risultati confrontabili con quelli dei giganteschi calcolatori, che si possono costruire alla superficie di un foglio (wafer), ottenuto sezionando cilindri monocristallini.

Ci si può chiedere quali saranno gli sviluppi futuri della microelettronica, e quando si giungerà alla saturazione delle potenzialità di miniaturizzazioni. Da questo limite siamo ancora lontani, perché gli elementi di circuito hanno attualmente le dimensioni lineari di ∼0.1 μm, mentre il limite teorico è quello del singolo atomo, con tipiche distanze reticolari di 10−3 μm.

Il grande sviluppo dei micrprocessori, con il numero enorme delle loro interconnessioni e posizioni di memoria, ha condotto ad alcuni risultati estremamente significativi, oltre alle possibilità di comunicazione che tutti utilizziamo. Anzitutto la realizzazione di potenzialità di calcolo praticamente illimitate. Non ci sono calcoli tanto complicati che essi non siano in grado di affrontare. Poi la capacità di affrontare problemi ritenuti tipici della mente umana, che ha introdotto il concetto di intelligenza artificiale, già ipotizzata dal matematico Alan M. Turing subito dopo la Seconda guerra mondiale nelle sue macchine calcolatrici ideali. In effetti la loro potenza di calcolo può condurre persino alla dimostrazione di teoremi matematici, come nel caso del famoso problema dei quattro colori, secondo il quale bastano quattro colori per individuare i confini di qualunque mappa di nazioni, qualunque sia il loro numero. La questione, posta nel 1852, eluse gli sforzi dei più grandi matematici, partendo da Hermann Minkowski che per primo la affrontò invano, fino a che due matematici dell'Università dell'Illinois, Kenneth Appel e Wolfgang Haken dimostrarono nel 1976 che il problema poteva essere ricondotto all'analisi di 1500 mappe fondamentali. Toccò allora al calcolatore eseguire le colorazioni, in tutte le distribuzioni possibili, cosa che avrebbe richiesto secoli agli uomini, e chiudere quindi la dimostrazione della validità del teorema dei quattro colori.

Un ulteriore risultato da segnalare è la possibilità di associare i microprocessori alla biologia molecolare, sia utilizzandoli per modellizzare molecole complesse sequenze di proteine (DNA), sia realizzando veri e propri microcircuiti, con transitor incorporati, costruiti con materiale biologico. Il parallelismo tra microcircuiti e funzionamento delle sinapsi e delle memorie del cervello umano può essere così studiato in profondità e condurre a scoperte nel campo della neurobiologia cerebrale.

Anche se la moderna tecnologia scopre materiali sempre nuovi e interessanti per scopi particolari, sembra certo che le proprietà uniche del silicio lo renderanno anche in futuro il materiale ideale e insostituibile per tutte le applicazioni della micro- e della nanoelettronica.

Optoelettronica ed energetica

Prima di concludere le semplici considerazioni qui svolte sul silicio, è opportuno accennare alle possibilità che il silicio offre anche nell'optoelettronica e nella conversione dell'energia solare.

Anzitutto si può osservare che, in ogni semiconduttore, alle giunzioni n-p in condizioni di grande drogaggio si ha emissione di luce per ricombinazione di elettroni e buche; i dispositivi così ottenuti sono detti LED (Light emitting diodes) (fig. 7). Utilizzando pareti riflettenti per la luce emessa, in condizioni di ripetuta emissione stimolata si può ottenere guadagno ottico, cioè si possono ottenere laser da giunzioni ad alto drogaggio. Il silicio cristallino non è il materiale adatto per questo processo, perché il minimo della banda di conduzione e il massimo della banda di valenza sono in punti diversi dello spazio →k (gap indiretta) e la ricombinazione è meno probabile, richiedendo la partecipazione di fononi. Il tempo di vita dei portatori è lungo, e ciò che è un vantaggio per le proprietà elettroniche di trasporto rappresenta uno svantaggio per le proprietà di conversione di corrente in luce.

Questo svantaggio è assai mitigato se per queste applicazioni si utilizza il silicio amorfo, anziché il silicio cristallino. Il silicio amorfo si ottiene dal fuso quando la cristallizzazione non è perfetta a causa del raffreddamento rapido, e il materiale ha soltanto un ordine a corto raggio, e non possiede più la simmetria di traslazione. In tal caso l'impulso ℏ →k non è più un buon numero quantico e le transizioni tra i livelli energetici sono sempre possibili senza richiedere la partecipazione di fononi vibrazionali. Per questo il silicio amorfo ha trovato applicazione come elemento base per sensori (rilevatori di O2 e NO2, che ne alterano la fotoluminescenza) e, potenzialmente, con un discreto guadagno ottico, per laser nell'infrarosso.

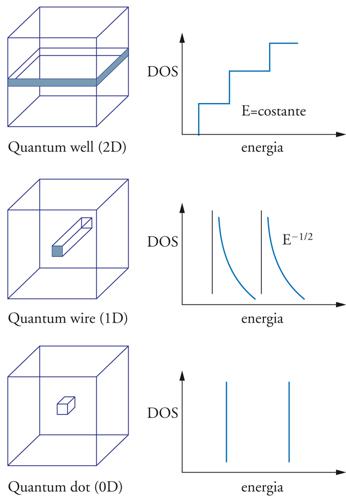

Una prospettiva estremamente interessante per le potenzialità optoelettroniche è costituita dalle nuove nanotecnologie, con le quali si costruiscono mediante deposizione epitassiale sostanze che in natura non esistono, ma che una volta realizzate sono stabili a temperatura ambiente. Esempi di tali sostanze sono i superreticoli, i pozzi quantici, o fili quantici, e i punti quantici (fig. 8). In essi il silicio è confinato da ossido isolante e la simmetria di traslazione è modificata o eliminata in una o più direzioni. Particolarmente promettenti sono i punti quantici che eliminano totalmente la simmetria di traslazione e consentono di ottenere livelli di energia prescelti controllandone le dimensioni. Con tali nanocristalli è stato ottenuto guadagno ottico e la strada è ormai aperta per la fabbricazione di laser a base di silicio, di frequenza controllabile. Tale risultato segnerebbe un progresso enorme nelle telecomunicazioni in fibra ottica e in altre applicazioni dei microlaser.

La tecnologia fotolitografica dei circuiti integrati è anche utilizzata per costruire cristalli fotonici, cioè con buche periodiche di dimensioni ottiche.

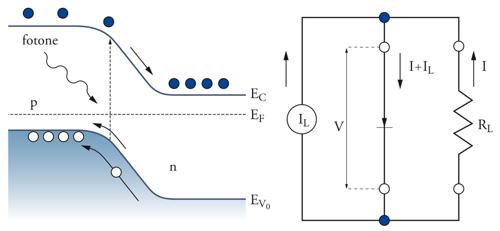

Un'ulteriore applicazione optoelettronica del silicio si ha nel procedimento inverso al precedente, per cui in una giunzione l'assorbimento di luce produce passaggio di corrente. Nello schema di fig. 9, si mostra che l'assorbimento dei fotoni produce elettroni e buche in eccesso nel semiconduttore, e gli elettroni per diffusione producono una corrente nel verso p-n della giunzione. Si genera così una fotocorrente nel verso opposto a quello in cui la giunzione agisce da raddrizzatore. Le celle solari sono l'applicazione più evidente di questo fenomeno; esse convertono l'energia della radiazione solare in energia elettrica. Poiché lo spettro della radiazione solare si estende dall'infrarosso all'ultravioletto (∼1-5 eV), ogni fotone assorbito trasferisce la sua energia agli elettroni del cristallo, ed essi decadono rapidamente al minimo della banda di conduzione prima del passaggio attraverso la giunzione, con generazione di fononi (produzione di calore); solo una parte dell'energia trasferita è convertibile. Questo fornisce un limite teorico al rendimento, ma il rendimento effettivo è ancora minore a causa di perdite varie e ricombinazioni prima del trasporto. Tutto ciò rende il silicio un materiale poco adatto per la conversione dell'energia solare. Tuttavia con silicio amorfo si è ottenuto un rendimento superiore al 10%, che non è trascurabile. Cristalli a giunzioni multiple, con gap decrescenti nelle diverse giunzioni sembrano promettenti per migliorare il rendimento delle celle solari.

In conclusione, anche se per l'optoelettronica esistono altre sostanze per loro natura più adatte (per es., GaAs), il silicio è tuttavia utile, e non è escluso che possa diventare anche in questo campo il materiale di maggiore interesse. È comunque certo che il silicio rimarrà la sostanza principale per la tecnologia elettronica, e forse fotonica, del terzo millennio.

Bibliografia

Bassani, Grassano 2000: Bassani, Franco - Grassano, Umberto M., Fisica dello stato solido, Torino, Bollati Boringhieri, 2000.

Bisi 1999: Silicon-based microphotonics: from basics to applications, edited by Olmes Bisi e altri, Amsterdam, IOS Press, 1999.

Kilby 1976: Kilby, Jack S., Invention of the integrated circuit, "IEEE transactions on electronic devices", 23, 1976, p. 648.

Pavesi 2000: Pavesi, Lorenzo e altri, Optical gain in silicon nanocrystals, "Nature", 408, 2000, pp. 440-444.

Seitz, Einspruch 1998: Seitz, Frederick - Einspruch, Norman G., Electronic genie, the tangled history of silicon, Urbana (Ill.), University of Illinois Press, 1998 (trad. it.: La storia del silicio, elettronica e comunicazione, Torino, Bollati Boringhieri, 1998).

Zimmermann 2000: Zimmermann, Horst, Integrated silicon optoelectronics, Berlin, Springer, 2000.

© Istituto della Enciclopedia Italiana - Riproduzione riservata